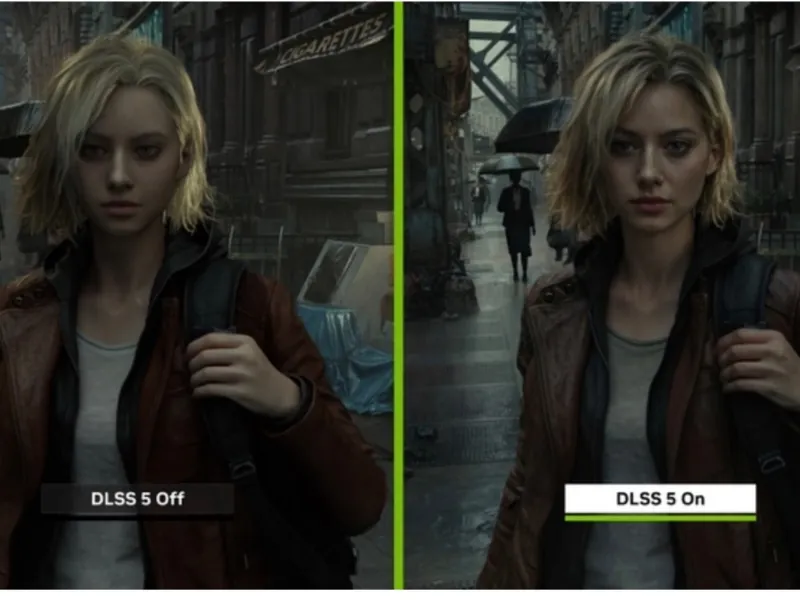

NVIDIA ha presentato DLSS 5 durante GTC 2026, introducendo un cambio di paradigma nella grafica in tempo reale che riguarda direttamente anche il rapporto tra rendering e produzione visiva avanzata.

NVIDIA ha presentato DLSS 5 durante GTC 2026, introducendo un cambio di paradigma nella grafica in tempo reale che riguarda direttamente anche il rapporto tra rendering e produzione visiva avanzata.

Il nuovo modello si basa su un approccio di neural rendering in tempo reale, che supera la logica tradizionale del solo incremento di potenza computazionale.

DLSS 5 non si limita più a ricostruire o generare pixel, ma interviene sulla loro qualità semantica, applicando illuminazione e materiali fotorealistici coerenti con la scena 3D originale.

Questo passaggio avvicina il rendering interattivo alle pipeline del cinema digitale, storicamente basate su tempi di calcolo non compatibili con il real time.

Architettura e modello operativo

DLSS 5 utilizza come input vettori di colore e movimento per ogni frame.

Su questa base, un modello AI addestrato end-to-end interpreta la scena, riconoscendo elementi complessi come pelle, capelli, tessuti e condizioni di luce.

Il risultato è una generazione deterministica di immagini, requisito fondamentale per il gaming ma anche per qualsiasi applicazione interattiva.

A differenza dei modelli generativi offline, il sistema mantiene coerenza frame-to-frame e aderenza all’intento artistico.

L’elaborazione avviene in tempo reale fino a 4K, mantenendo una latenza compatibile con il gameplay.

Evoluzione rispetto alle generazioni precedenti

DLSS nasce nel 2018 come tecnologia di upscaling basata su AI.

Con versioni successive introduce frame generation e ricostruzione avanzata dell’immagine.

Con DLSS 5 il focus si sposta dalla performance alla fedeltà visiva, con un approccio ibrido che combina rendering tradizionale e generazione neurale.

Si tratta della prima implementazione su larga scala di un modello in grado di operare direttamente sulla fisica apparente dei materiali e della luce, anziché sulla sola risoluzione.

Implicazioni per il settore media e broadcast

L’impatto non riguarda esclusivamente il gaming.

La logica introdotta da DLSS 5 apre scenari rilevanti per:

- produzione virtuale e ambienti LED

- real-time graphics per broadcast

- simulazioni interattive e XR

- pipeline ibride tra CGI e AI

La possibilità di ottenere shading e materiali credibili senza path tracing completo riduce drasticamente il gap tra contenuti offline e real time.

In prospettiva, questo approccio può influenzare anche motori grafici utilizzati in ambito televisivo, dove il compromesso tra qualità e latenza è ancora centrale.

Ecosistema e adozione

Il supporto coinvolge publisher e studi come Bethesda, CAPCOM, Ubisoft e Warner Bros. Games.

L’integrazione avviene tramite framework Streamline, già utilizzato per le versioni precedenti e per NVIDIA Reflex.

Tra i titoli previsti figurano produzioni ad alta complessità visiva come Starfield e Assassin’s Creed Shadows, contesti ideali per testare la resa su larga scala.

Inquadramento tecnologico

DLSS 5 si inserisce in una traiettoria che parte dagli shader programmabili di inizio anni 2000, passa per CUDA e il ray tracing in tempo reale, fino alle recenti implementazioni di path tracing e neural shader.

La discontinuità introdotta riguarda il fatto che la qualità finale dell’immagine non è più determinata solo dal renderer, ma da un modello AI che interpreta e arricchisce la scena.

Se consolidato, questo modello può ridefinire il ruolo del rendering engine, spostando parte della pipeline verso sistemi neurali controllati.

Sinossi

DLSS 5 introduce il neural rendering in tempo reale, applicando illuminazione e materiali fotorealistici direttamente sui pixel generati.

La tecnologia sviluppata da NVIDIA segna il passaggio da un approccio orientato alla performance a uno focalizzato sulla qualità visiva.

L’impatto riguarda anche produzione virtuale, grafica broadcast e pipeline ibride tra CGI e AI.

#NVIDIA, #DLSS5, #AIgraphics, #realtimerendering, #virtualproduction, #broadcasttech, #computergraphics, #gamingtech, #neuralrendering, #digitalproduction