Percepisci gli oggetti nel mondo attraverso i sensi e costruisci scene combinando oggetti e viceversa.

Percepisci gli oggetti nel mondo attraverso i sensi e costruisci scene combinando oggetti e viceversa.

Il riconoscimento di oggetti e scene è un campo di ricerca attivo che mira alla progettazione di macchine intelligenti e alla creazione di rappresentazioni digitali di oggetti e scene.

Sul fronte umano, la ricerca è ancora impegnata nel cercare di capire come diverse parti del cervello cooperino nella creazione di una comprensione di una scena e dei suoi oggetti.

Molto probabilmente, molti hanno supposto che "oggetti e scene" fossero preceduti dalla parola "visivi".

Tuttavia, non era questa l'intenzione.

MPAI è interessata a oggetti e scene preceduti da aggettivi visivi, uditivi e audio-visivi.

MPAI è particolarmente interessata alla descrizione di oggetti e scene visive, uditive e audio-visive, poiché si occupa di una varietà di casi d'uso che condividono l'utilizzo di questa tecnologia.

Un Veicolo Connesso Autonomo deve creare una ricca descrizione della scena audio-visiva attorno ad esso per raggiungere autonomamente il suo obiettivo di destinazione.

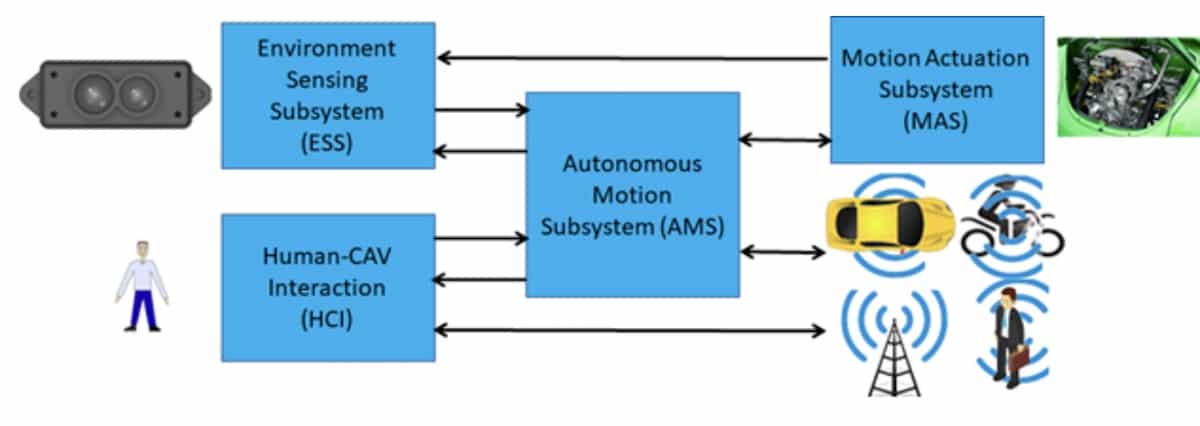

Nello standard Architettura MPAI Connected Autonomous Vehicle (MPAI-CAV), la scena audio-visiva e i suoi componenti possono essere prodotti da diverse tecnologie che condividono un'entità chiamata Basic Environment Representation (BER) basata su una tecnologia di Descrizione di Oggetti e Scene condivisa da diverse Tecnologie di Sensore Ambientale (EST).

Il Sottosistema di Rilevamento Ambientale combina le Descrizioni della Scena da specifiche EST per produrre la migliore BER ottenibile con le EST disponibili nel CAV.

Il Sottosistema di Movimento Autonomo scambia parti della propria BER con altri CAV nell'area, ottenendo la Full Environment Representation (FER), la migliore rappresentazione digitale dell'ambiente basata sulla sua comprensione e su quella di altri CAV collaboranti.

È possibile per un CAV sviluppare l'operazione descritta sopra se esiste una rappresentazione standard delle potenzialmente complesse scene audio-visive attorno ad esso.

Nel caso d'uso Videoconferenza basata su Avatar (PAF-ABV), gli esseri umani inviano i modelli dei loro avatar a un server il cui compito è selezionare una sala riunioni, assegnare posti agli avatar che partecipano alla riunione virtuale e trasmettere queste informazioni a tutti i client partecipanti in modo che possano ricreare la stessa scena in 3D.

Mentre nello standard Architettura CAV, l'informazione audio gioca un ruolo relativamente importante, nel caso d'uso PAF-ABV, l'audio è di vitale importanza per un'adeguata esperienza utente.

Pertanto, ogni cliente dovrebbe "associare" il discorso appropriato alla bocca di ciascun avatar in modo che il discorso abbia una direzione perpendicolare al volto dell'avatar.

Quindi, ogni avatar (cioè ogni persona che lo guida) può trovarsi in un campo sonoro che è la somma dei segnali vocali provenienti da tutte le bocche degli avatar e dai loro riflessi.

Quando un avatar gira il volto verso l'avatar a cui intende parlare, sentirà la corretta miscela di suoni.

Nella Versione 2 del suo standard di Miglioramento Audio basato sul Contesto (MPAI-CAE), MPAI ha sviluppato una versione iniziale della tecnologia Audio Scene Description (CAE-ASD) la cui struttura di base è composta da una serie di Descrittori spiegati di seguito.

Header: CAE-ASD-x.y dove x e y sono la versione e la sottoversione (attualmente 2 e 1).

ASDID: Identificatore di una raccolta di singoli ASD che descrivono un'istantanea della Scena ed è espresso da UUID di 16 byte.

Time: include un bit che definisce il tipo di tempo di inizio: per il tempo relativo, cioè da un tempo arbitrario, e per il tempo assoluto, cioè dal 1970/01/01T00:00 (tempo Unix).

Include anche un Inizio Tempo e Fine Tempo forniti in microsecondi dall'inizio e alla fine del tempo corrente degli Audio Scene Descriptors.

Dimensione Blocco: indica il numero di byte che compongono gli attuali Audio Scene Descriptors.

Conteggio Oggetti Audio: rappresenta il numero totale di oggetti negli attuali Audio Scene Descriptors.

Infine, abbiamo l'insieme di dati audio di ciascun Oggetto Audio:

Identificatore Oggetto Audio

Frequenza di campionamento audio (da 8 a 192 kHz).

Numero di bit per campione (da 16 a 64 bit).

Posizione Spaziale.

Dati specifici dell'Oggetto Audio.

La Posizione Spaziale è un'entità specificata dallo standard Descrizione di Oggetti e Scene (MPAI-OSD). È una struttura dati che include:

Tipo di Coordinate, per Coordinate Cartesiane e Sferiche.

Tipo di Oggetto, per Umano Digitale e Oggetto Generico.

Tipo di Media, segnalando i tipi di media Audio, Visivo, Tattile, Olfattivo, RADAR, LiDAR e Ultrasuoni.

La Maschera di Posizione Spaziale specifica i valori degli ultimi 3 set di variabili nella Posizione Spaziale relative a Posizione Cartesiana o Sferica, e Orientamento, e le loro velocità e accelerazioni.

Il campo Oggetto Audio è agnostico al formato dati utilizzato. Fornisce semplicemente:

Identificatore del formato dati dell'Oggetto Audio.

Numero di byte utilizzati per rappresentare l'Oggetto Audio.

I Dati dell'Oggetto Audio.

Lo standard MPAI-OSD ha preso in prestito le principali nozioni di CAE-ASD per sviluppare le Descrizioni di Scena Visiva e Audio-Visiva (OSD-VSD e OSD-AVD, rispettivamente).

Alcuni elementi delle due Descrizioni di Scena sono diversi, ma la struttura generale è la stessa.

Per questo motivo, la Descrizione di Scena Audio-Visiva MPAI è una struttura generale in grado di descrivere una Scena composta da un numero arbitrario di Oggetti Audio, Visivi e Audio-Visivi. Si noti che l'obiettivo dello standard MPAI-OSD è specificare i Formati dei Dati che consentono la descrizione e la localizzazione di Oggetti e Scene uni- e multi-modali in uno Spazio Virtuale per un uso uniforme attraverso le Specifiche Tecniche MPAI.

Sia MPAI-OSD V1 che MPAI-CAE V2.1 sono pubblicati con richieste di commenti.

Chiunque è invitato a leggere gli standard nelle pagine web di OSD e CAE e fornire commenti entro il 17 gennaio (OSD) e il 23 gennaio (per CAE) del 2024.

In un mondo in cui la tecnologia cambia il tuo contesto da un giorno all'altro, come puoi evitare di essere sopraffatto, rimanere al controllo ed sfruttare le opportunità?

MPAI è l'organismo che viene in tuo soccorso:

MPAI riguarda i dati, il carburante che mantiene in moto il motore della nostra società.

MPAI riguarda il coding, la trasformazione che rende i dati sfruttabili.

MPAI riguarda l'uso dell'Intelligenza Artificiale, la tecnologia che sta plasmando il nostro futuro.

MPAI riguarda la fornitura di spiegazioni, consentendo agli esseri umani di capire cosa fanno le macchine.

MPAI riguarda la creazione di standard, il linguaggio per la comunicazione tra esseri umani e macchine.

MPAI riguarda la tempestività, dodici mesi da un'idea a uno standard.

MPAI riguarda l'efficacia, dieci standard prodotti in tre anni.

MPAI riguarda la convergenza, una tecnologia comune al servizio di molti settori.

MPAI riguarda la collaborazione, con altri organismi di standardizzazione come l'IEEE.

MPAI riguarda l'ecosistema, supportando gli attori dalla definizione degli standard ai prodotti.

Unisciti a MPAI, condividi il divertimento, costruisci il futuro!

INFO https://mpai.community/how-to-join

#Tecnologia #IntelligenzaArtificiale #Standardizzazione #Dati #Innovazione #Collaborazione #SviluppoTecnologico #MPAI #EcosistemaDigitale #FuturoTecnologico